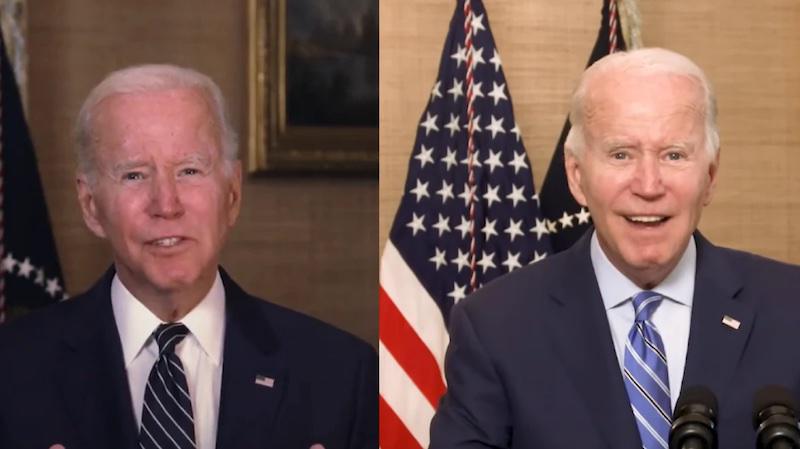

أصدرت السلطات الأمريكية في نيو هامبشاير تحذيرات بعد اكتشاف مكالمة آلية مزورة استخدمت تقليدًا لصوت الرئيس جو بايدن، صادرة عن شركة متخصصة في الذكاء الاصطناعي مقرها تكساس. وقد أعاد هذا الحادث إثارة المخاوف بشأن إمكانية إساءة استخدام تقنيات توليد الصوت عبر الذكاء الاصطناعي للتأثير سلبًا على العملية الانتخابية، بما في ذلك إلغاء الأصوات، وتشويه سمعة المرشحين السياسيين، أو التحريض على العنف.

حذر السارجنت المحقق جيرالد يوت، من شرطة ولاية ميشيغان، من المخاطر المرتبطة بالنسخ الصوتي عبر الذكاء الاصطناعي، موضحًا أن هذه التقنية يمكن أن تتلاعب بصوت شخص ما لإنشاء عمليات احتيال مقنعة، مما يجعل من الصعب على الضحايا التمييز بين الحقيقة والزيف. في الوقت الحالي، لا توجد تشريعات فيدرالية أو ولائية تحظر بشكل خاص استخدام صوت الشخص دون معرفته أو دون إذنه.

أظهر ماثيو مارتن، صاحب شركة صغيرة، مدى سهولة توليد تقليد صوتي مقنع باستخدام تقنية الذكاء الاصطناعي، ملقيًا الضوء على ضرورة اليقظة. أمام هذا التهديد، تنصح الشرطة المواطنين بإنشاء كلمة سر أو شيفرة عائلية للحماية من عمليات الاحتيال الصوتية.

أنشأ مكتب المدعي العام في ميشيغان آلية للإبلاغ عن النسخ الصوتي وغيره من الاحتيال المتعلق بالذكاء الاصطناعي. على الرغم من أن تقنية النسخ الصوتي عبر الذكاء الاصطناعي لا تزال في مراحلها الأولى، إلا أن الشرطة المدربة بشكل صحيح قادرة حاليًا على التمييز بين الأصوات الاصطناعية والأصوات البشرية الحقيقية من خلال تحليل نطاقات التردد، مما يقدم بصيص أمل في مكافحة هذا النوع من الاحتيال.